歐洲要求平臺對 AI 生成內容進行標記來打擊假新聞

歐洲聯盟呼籲《網路虛假訊息行為準則》的簽署方對深度偽造和其他 AI 生成的內容進行標記。在昨天與《準則》的 40 多名簽署方會面後,歐盟的價值觀與透明度專員維拉·尤羅娃表示已經簽署打擊虛假訊息的人應當推出技術來識別 AI 內容,並將其清晰標記給使用者。“新的 AI 技術可以是積極的力量,並提供了更高效和創造性表達的新途徑。但同樣,我們必須提及這一問題的黑暗面,它們也帶來了新的風險和對社會的負面影響潛力。當涉及到虛假訊息的創作和傳播時,“尤羅娃警告說。“像 ChatGPT 這樣的高級聊天機器人能夠在幾秒鐘內建立復雜而看似有說服力的內容和視覺效果。影象生成器可以建立看起來真實的事件照片,而這些事件從未發生過。聲音生成軟體可以根據幾秒鐘的示例模仿某人的聲音。新技術也對打擊虛假訊息提出了新的挑戰。因此今天我要求簽署方在《準則》中建立一個專門的、獨立的軌道來討論這一問題。”

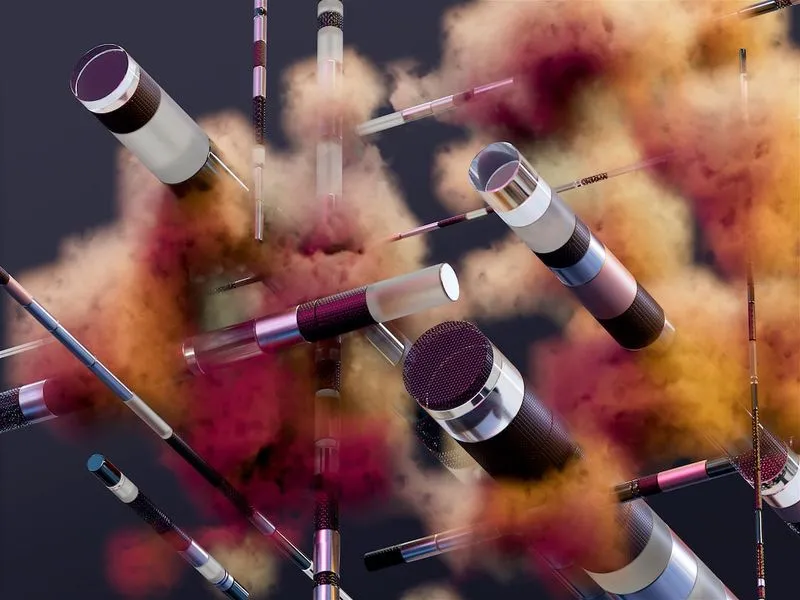

假新聞和 AI 生成內容之亂

AI 技術越來越多地用於幫助人們制造有逼真效果的假影片,從而傳播虛假訊息。此舉已經對社會產生了巨大的負面影響,特別是在政治領域中。當通常認為社會媒體平臺是釋出虛假訊息的獨特場所時,AI 對這一情況的增強只會使問題變得更加複雜。因此《準則》要求平臺繼續努力,使 AI 的使用得到控制,進一步打擊虛假新聞的傳播。

AI 生成的內容應進行標記

尤羅娃指出,標記 AI 生成的內容可以使普通使用者立即理解他們被呈現的內容是由機器生成的,而不是由人類生成的。同時該委員會希望平臺立即實施標記,以便使用者能夠正確識別 AI 生成的內容。《數位服務法》(DSA) 的某些規定要求非常大的線上平臺(VLOP)標記被篡改的音訊和影象,但尤羅娃表示向《準則》中新增標記的想法是,即使早於 DSA 下的 VLOP 在 8 月 25 日的遵循期限之前,也可以實現。

該如何解決 AI 生成的內容問題?

欲解決 AI 生成的內容問題,尤羅娃提出兩種主要討論角度。第一種集中於整合生成 AI 的服務,如微軟的新必應搜尋或 Google 的 Bard AI 增強搜尋服務-這些服務應該承諾建立“必要的保障措施,以使這些服務不能被惡意行為人用於生成虛假訊息”,第二種則要求有潛力傳播 AI 生成虛假訊息的簽署人提供“識別此類內容的技術,並向使用者清晰地加以標記”。尤羅娃表示她已經與 Google 的桑達爾·皮查伊(Sundar Pichai)交流過,並被告知 Google 擁有可以檢測 AI 生成的文字內容的技術,但仍在開發技術以提高其功能。必須指出的是,現版本的《準則》不包括識別和標記深度偽造技術。

平臺必須承擔責任

平臺是虛假訊息的主要傳播者。它們必須承擔起認真思考 AI 生成內容的責任。年輕人面臨著不斷發展的訊息散播的世界,必須為他們提供一個安全的環境。尤羅娃認為,平臺應向公眾進一步透明其整合機器人技術和人工製作內容的方式、以及用於檢測和回應虛假報告的技術。

總結

虛假訊息瞬息萬變,揭示了訊息時代帶來的巨大威脅:它絕不能掩蓋對追求真理的渴望。歐盟對 AI 生成的內容提出的要求和所有相關的法規,或許可以培養更加健康的訊息環境,讓人民得以追求真正的訊息自由。

延伸閱讀

- 印度選舉飽受網路虛假訊息之苦

- 遊戲產業低迷中,Bitkraft Ventures 籌得 2.75 億美元支援遊戲公司與平臺

- 資料庫公司 DataStax 收購低程式碼 AI 平臺 Langflow 的新創公司

- TikTok 歐洲推出專注於 STEM 領域的專頁

- 蘋果、Google 和微軟常用的團隊建設平臺 Confetti 募集到 1600 萬美元

- 世界幣在歐洲再次被禁止,稱對兒童存在風險

- 線上補習平臺 GoStudent 在妥協中實現盈利

- 北約創新基金支援,OTB Ventures 將向歐洲深科技投資 1.85 億美元

- NFT 平臺 Zora 提供了一種新的賺錢方式,適合 AI 模型製作者

- 政治深度假像如野火般蔓延,感謝 GenAI