AI 的崛起:智慧思考的代價或將是私隱的死亡

背景

近年來人工智慧(AI)取得了巨大的發展,特別是生成式 AI 的普及與 OpenAI 的引領。人們對於 AI 在各個領域的應用抱有極大的期望,並預測將會出現一個 AI 版本的「iPhone 時刻」。

AI 對私隱的威脅

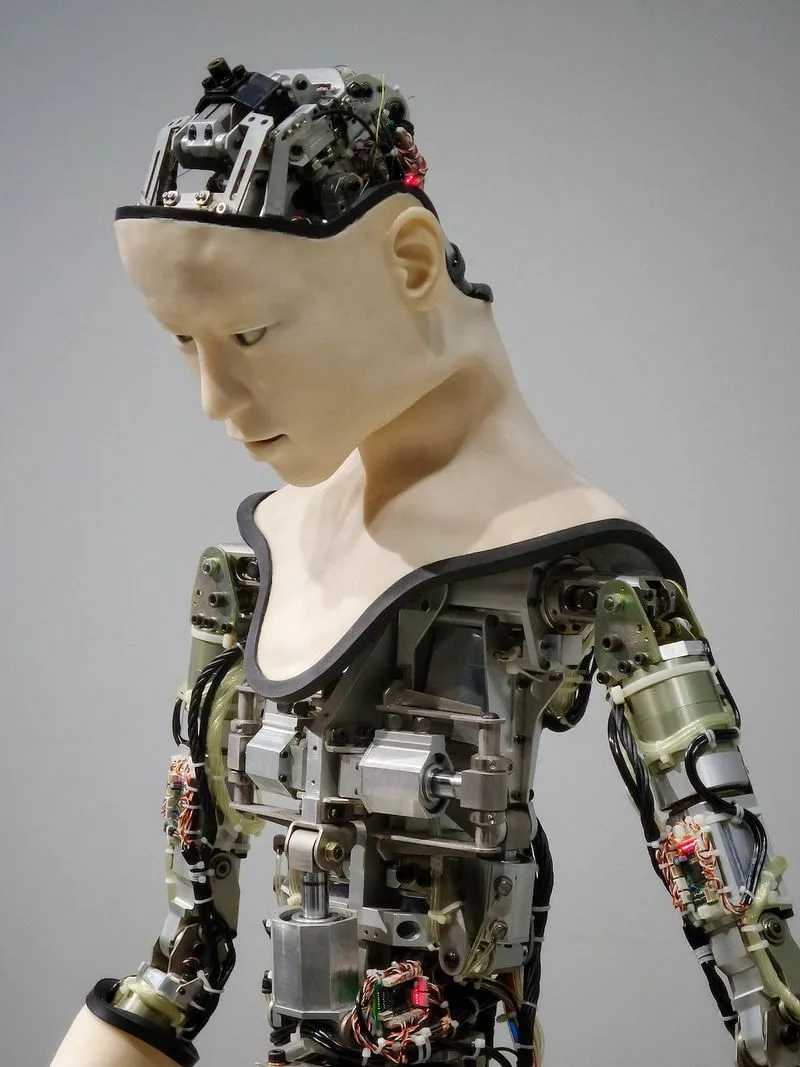

然而隨著 AI 的快速發展,私隱也面臨著巨大的威脅。生成式 AI 類似 OpenAI 的 ChatGPT,能夠模擬人類行為,但並非真正的思考和知識。這些 AI 模型需要大量的資料作為輸入,包括由使用者在網際網路上自由釋出的數位訊息以及未來可能由裝置收集的使用者的物理世界資料。

AI 與監控

AI 本身就是一種監控技術,它需要監控我們的資料以實現其功能。它還可以用於影象識別、情感分析等各種應用。儘管這些監控是為了實現一個具有思考和知識能力的虛擬助手,但也需要付出較高的私隱代價。

AI 時代下的私隱

在 AI 時代,我們或許需要重新思考私隱的定義。當我們追求一個具有與我們自己一樣全面理解我們生活的 AI 時,我們必須放棄一部分我們所能收集或擁有的資料。此時,資料是否離開我們的本地裝置或虛擬智慧的居住地將變得不那麼重要,因為我們的訊息將與另一個「他者」共享,即使這個「他者」並非具有肉體存在。

AI 的 iPhone 時刻與私隱

在 AI 的發展道路上,實現智慧思考的「iPhone 時刻」必然要求我們放棄私隱。這會對那些以保護私隱為核心區別點的公司(如蘋果)帶來困擾。他們在未來十年或更長的時間內將面臨奇特的處境。

評論與建議

AI 的發展必然與私隱問題相伴相生,而私隱的死亡是否真的值得 AI 的發展?這是一個需要深思熟慮的問題。在 AI 發展的道路上,我們需要權衡利弊,並制定出更加合理、平衡的 AI 規範和政策。

同時作為個人,我們應該更加關注和保護自己的私隱。我們應該理解我們在網際網路上分享的訊息可能被收集和再利用,並注意隱私政策的變化。此外我們應該對與 AI 相關的新技術、新產品保持警覺,理解它們可能對私隱帶來的潛在威脅。

最重要的是,AI 的發展需要有一個公正、開放的討論平臺,讓各界專家、學者和公眾能夠就 AI 和私隱等議題進行深入的討論和對話,以確保 AI 的應用不會過度侵犯我們的私隱權益。